Un aviso serio a la abogacía: supervisar siempre lo que dice la Inteligencia Artificial

La Sala de lo Penal del Tribunal Superior de Justicia de Canarias ha impuesto una multa de 420 euros a un abogado que incluyó en un recurso de apelación hasta 48 citas de sentencias del Supremo y un informe del CGPJ que, en realidad, no existían y habían sido generadas por una herramienta de IA generalista. El letrado reconoció ante los magistrados que confió en esas referencias sin comprobarlas en bases de datos oficiales como Cendoj y asumió “plenamente” su falta de diligencia.

Qué ha pasado: 48 sentencias falsas en un recurso penal

El caso arranca con un recurso de apelación presentado ante el TSJ de Canarias contra una sentencia de la Audiencia Provincial de Santa Cruz de Tenerife en un procedimiento penal. Para fundamentar su postura, el abogado acudió a una IA generalista, que le sugirió resoluciones del Tribunal Supremo y un informe del Consejo General del Poder Judicial supuestamente favorables a su tesis.

En total, el recurso incorporaba 48 citas jurisprudenciales y ese informe como apoyo jurídico. Cuando la documentalista del TSJ canario intentó localizarlas en las bases de datos, comprobó que ni los números de sentencia, ni las fechas, ni los identificadores coincidían con ninguna resolución real.

El tribunal concluye que el letrado no sometió a “revisión ni verificación alguna” los resultados de la IA: no contrastó numeración, ni fechas, ni comprobó una sola de las referencias en Cendoj, pese a ser una base de datos pública, gratuita y de uso habitual en la práctica forense. Esa falta de contraste es la base de la sanción por vulnerar el deber de veracidad y las reglas de la buena fe procesal.

Claves jurídicas y deontológicas: qué le reprocha el tribunal

La Sala aprecia una actuación contraria al deber profesional de veracidad y a la buena fe procesal, al introducir en un escrito judicial un bloque de jurisprudencia inventada presentada como si fuera real. No se discute que el abogado pudiera usar IA como apoyo, sino que lo hiciera sin el mínimo control humano exigible a un profesional de la abogacía.

En términos deontológicos, el tribunal habla de “quiebra del deber básico de supervisión humana” cuando se emplean herramientas de IA en el ejercicio profesional. Recuerda que el Código Deontológico obliga al abogado a mantener un estándar de diligencia que no puede delegarse en sistemas automáticos, por muy sofisticados que sean.

La resolución subraya que la IA debe entenderse como instrumento “asistencial y nunca decisorio”, y que una dependencia ciega del sistema vulnera ese estándar. Por eso, además de la multa económica, la Sala acuerda remitir la sentencia al Colegio de Abogados del afectado para que, si lo considera oportuno, abra un expediente disciplinario.

Una multa “ejemplarizante”: por qué 420 euros

El tribunal fija la sanción en 420 euros y explica que busca un efecto “ejemplarizante”. La cifra se corresponde, aproximadamente, con la mitad del coste anual de una suscripción a una herramienta de IA jurídica específica disponible en el mercado.

La Sala apunta que, de haberse usado una solución profesional de este tipo —y no una IA generalista—, “probablemente” se habría evitado el resultado. También tiene en cuenta, a la hora de cuantificar la multa, que el abogado admitió los hechos, reconoció su responsabilidad y mostró un arrepentimiento que los magistrados califican como “aparentemente sincero”.

No se trata, por tanto, de una sanción elevada en términos económicos, sino simbólica en clave de mensaje al sector jurídico: la responsabilidad última sobre lo que se firma y se presenta al tribunal es siempre humana. El aviso va dirigido a toda la abogacía en un momento en que el uso de IA en despachos y asesorías se está popularizando.

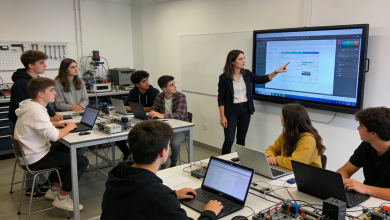

Contexto: el auge de la IA en despachos y el paralelismo con otros países

El caso llega en plena expansión de herramientas de IA en despachos españoles, no solo para redactar borradores de escritos, sino también para sugerir argumentos, revisar contratos o resumir jurisprudencia. La resolución del TSJ canario se suma a advertencias semejantes emitidas por tribunales de otros países, como Estados Unidos, donde ya se han dado casos de sanciones a letrados por presentar sentencias inventadas generadas por chatbots.

En España, la sentencia pone negro sobre blanco una idea que muchos colegios de abogados ya venían trasladando en charlas y circulares: la IA puede ahorrar tiempo, pero no sustituye el criterio jurídico ni las comprobaciones en bases de datos oficiales. El hecho de que el tribunal cite expresamente Cendoj, de acceso libre, subraya que había herramientas suficientes para verificar las referencias sin coste adicional.

Además, la resolución puede influir en cómo las aseguradoras de responsabilidad civil profesional valoran los riesgos asociados al uso de IA en la abogacía, y en la formación que los colegios ofrecerán sobre estos sistemas. La idea de la “supervisión humana indeclinable” se alinea también con las exigencias del Reglamento europeo de IA, que coloca a los profesionales como responsables últimos del uso de herramientas de alto impacto.

Qué implica para abogados, clientes y ciudadanos en España

Para los abogados, el mensaje es claro: usar IA no está prohibido, pero requiere aplicar el mismo rigor que si el trabajo lo hubiera realizado un pasante o un colaborador del despacho. Eso significa verificar datos, comprobar jurisprudencia en fuentes oficiales y asumir que el profesional firma con su nombre todo lo que pone en un escrito, venga de donde venga.

Para los clientes, el caso evidencia la importancia de exigir calidad y responsabilidad en el trabajo jurídico, independientemente de que el despacho use herramientas tecnológicas avanzadas. La IA no exime de la obligación de actuar con diligencia, y errores graves como citar jurisprudencia inexistente pueden perjudicar la defensa de un asunto, además de dañar la confianza en el sistema.

Para la ciudadanía en general, la sentencia marca un precedente en la adaptación de la Justicia española a la era de la IA: los tribunales no rechazan la tecnología, pero fijan líneas rojas claras sobre el deber de control humano. En un momento de proliferación de herramientas gratuitas y generalistas, el caso sirve de recordatorio de que, en ámbitos sensibles como el jurídico, confiar ciegamente en esos sistemas puede tener consecuencias profesionales y procesales.